De Radboud Universiteit in Nijmegen heeft een nieuwe benadering van kunstmatige intelligentie (artificial intelligence: ai) ontwikkeld die beter met onzekerheid kan omgaan. De innovatieve methode vindt sneller veiliger opties, bijvoorbeeld in zelfrijdende auto's.

Dit blijkt uit een nieuw onderzoek door wetenschappers van de Radboud Universiteit, in samenwerking met de University of Austin, University of California (Berkeley) en Technische Universiteit Eindhoven. De Association for the Advancement of Artificial Intelligence (AAAI) gaat de studie binnenkort publiceren.

De wetenschappers hebben een methode ontwikkeld om te redeneren over onzekerheid. Het gaat om een nieuwe benadering voor het zogenaamde ‘onzekere, gedeeltelijk waarneembare Markov-beslissingsproces’. Simpel gezegd zijn dit modellen gebaseerd op werkelijkheid die de kans op een gebeurtenis inschatten.

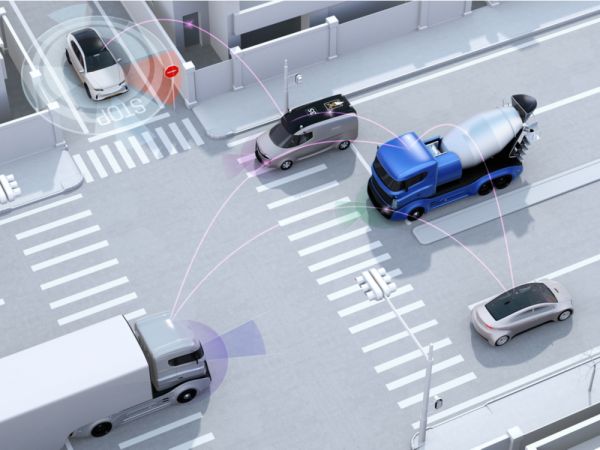

Een zelfrijdende auto komt bijvoorbeeld met allerlei onbekende situaties in aanraking wanneer deze begint te rijden. Om de ai van zelfrijdende auto’s te valideren, zijn uitgebreide berekeningen nodig. Deze moeten analyseren hoe de ai met verschillende situaties om zou gaan. De onderzoekers stellen dat deze analyses realistischer zijn te maken met behulp van de nieuwe benadering, en aldus de ai sneller betere en veiligere beslissingen kan nemen.

Verwerkingskracht

Gedeeltelijk waarneembare Markov-beslissingsprocessen (Pomdp’s) worden al in de praktijk gebruikt om allerlei situaties te simuleren en modelleren. Deze Pomdp’s spelen bijvoorbeeld een rol om de verspreiding van een epidemie te voorspellen. Ook valt hiermee te berekenen hoe lucht- en ruimtevaartuigen een botsing kunnen voorkomen. Zelfs bij onderzoek naar bedreigde diersoorten vinden ze toepassing.

Nils Jansen, assistent hoogleraar aan de afdeling Software Science (SWS) van de Radboud Universiteit, stelt vast dat we weten dat deze modellen een realistisch beeld kunnen geven van de echte wereld. ‘Door de grote hoeveelheid verwerkingskracht die nodig is om ze te gebruiken, worden ze in de praktijk echter weinig ingezet. Dankzij deze nieuwe benadering kunnen we al onze berekeningen en theoretische informatie consistenter en regelmatiger in de echte wereld gebruiken.’

Vage benadering

De doorbraak is te danken aan het feit dat het onderzoeksteam de onzekerheid van de echte wereld expliciet in de modellen heeft opgenomen. Jansen: ‘Huidige modellen vertellen je bijvoorbeeld dat er een kans van tachtig procent is dat een rit in een zelfrijdende auto helemaal veilig is. Het is onduidelijk wat er bij die andere twintig procent van de gevallen kan gebeuren, en wat voor soort risico je dan kunt verwachten. Dat is een onduidelijke, vage benadering van risico. Met deze nieuwe benadering kan een systeem veel gedetailleerdere verklaringen geven van wat er mis kan gaan en dit meenemen in de berekeningen. Op deze manier krijgen gebruikers specifiekere voorbeelden van wat er mis kan gaan en kunnen ze betere, en meer toepasselijke aanpassingen doorvoeren om die specifieke risico´s te voorkomen.’

De benadering die de onderzoekers hebben gebruikt voor dergelijke beslissingsprocessen is eerder door andere onderzoekers gebruikt, maar alleen in specifieke, beperkte situaties en bij gedachte-experimenten. ‘Voor de eerste keer hebben we deze eerdere theoretische gedachte-experimenten in een praktische, realistische benadering weten te verwerken’, vertelt Jansen. ‘Dit werd als een uniek en moeilijk probleem beschouwd, maar dankzij onze interdisciplinaire aanpak hebben we een doorbraak kunnen maken.’