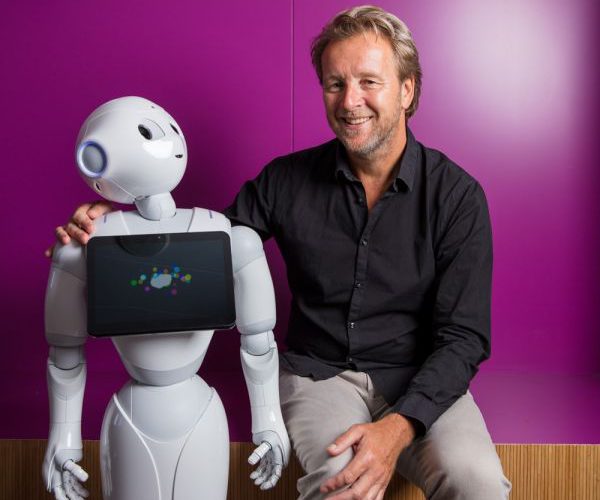

Eén van de blikvangers in het Computable Future Lab tijdens de vakbeurzen Infosecurity en Data & Cloud Expo 2018 was een robot van een aantal VU-onderzoekers. Die robot kan door menselijke taal en interactie met de omgeving een gesprek aangaan met een omstander. Bekijk de video waarin Marlies kennismaakt met de robot.

Op dit moment heeft de robot een database met 50.000 gezichten en bekijkt die aan de hand van de persoon die voor hem staat of hij diegene al kent. Als de robot de persoon die voor hem staat niet herkent, volgt een kennismakingsgesprek

De robot is zo geprogrammeerd dat deze menselijke taal kan interpreteren. Bovendien zoekt de robot ook informatie op internet op, bijvoorbeeld als het apparaat niet begrijpt wat een bepaalde hobby is. Ook verifieert de robot bij de gesprekspartner of die informatie klopt en leert die zo stapsgewijs meer over zijn gesprekspartner.

Volgens VU-hoogleraar Piek Vossen, leider van de onderzoeksgroep van de robot, is het trainen van een robot vergelijkbaar met de manier waarop kinderen dingen aangeleerd krijgen via taal en ervaringen. ‘Bij machine learning en robots draait het om leren op basis van ervaringen, de robot neemt iets waar met zijn sensoren en probeert dat te interpreteren. Dat is goed of fout en vervolgens krijgt de robot feedback.’

Naast leren door ervaring kan de robot ook leren door taal. De robot kan op basis van taal informatie interpreteren. Dat is specifiek anders dan bij een robot die wordt aangestuurd via een voorgeprogrammeerde opdracht en deze uitvoert. Er ontstaat interactie.

In een uitgebreid interview dat eerder in Computable magazine verscheen, gaat Vossen daar verder op in.

Emotie herkennen

Het gaat nu nog om een prototype. Maar, in een volgende stap kunnen ook interpretaties van de gemoedstoestand van de gesprekspartner worden gedaan. Bijvoorbeeld aan de hand van een audio-analyse. Vossen: ‘De robot hoort of iemand snel praat, kortademig is, door gebruik van bepaalde woordkeuzes is te analyseren of er sprake is van een bepaalde emotie, dat kan ook via analyse van gezichtsuitdrukkingen.’ Die informatie kan via een algoritme worden geanalyseerd en daar kan dan een bepaalde emotie aan worden gekoppeld, legt Vossen uit.

Op de beursvloer van Infosecurity en Data & Cloud Expo in de Jaarbeurs Utrecht zijn er nog wel wat extra barrières voor een vlotte kennismaking met de robot. Lichtval is bijvoorbeeld erg belangrijk. De camera heeft moeite met tegenlicht. De robot blijft dan zoeken en kijkt wat schuchter om zich heen. Bij de demo op de beurs wordt ook gebruik gemaakt van een microfoon. In een rustige ruimte is dat niet nodig. Vanwege het omgevingsgeluid op de drukke beursvloer is in de demo voor de opzet met microfoon gekozen.

Benieuwd hoe Marlies kennismaakt met de robot? Bekijk de video.